🇪🇺 We’re the EU/German part

🇨🇭 For Switzerland: @algorithmwatchch.bsky.social

🌐 https://algorithmwatch.org/

Wir klären hier darüber auf: algorithmwatch.org/de/explainer...

Wir klären hier darüber auf: algorithmwatch.org/de/explainer...

On Friday, in your inbox 📬 automatedsociety.algorithmwatch.org#/en

On Friday, in your inbox 📬 automatedsociety.algorithmwatch.org#/en

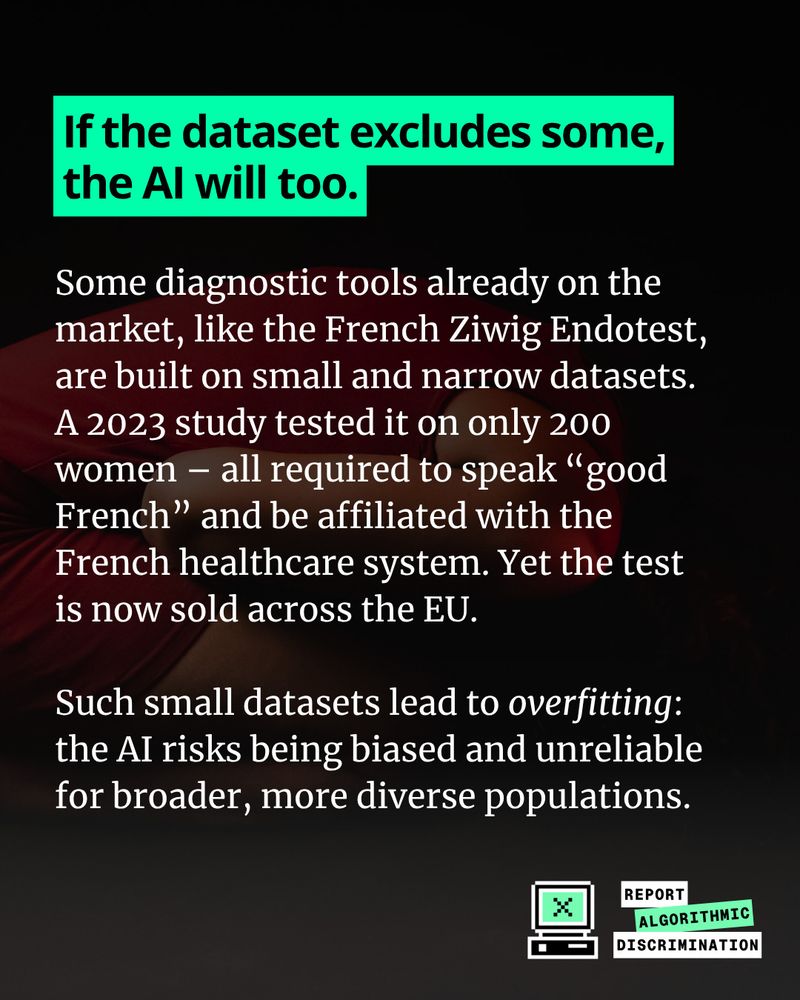

👉 Read the whole article: algorithmwatch.org/en/when-will...

👉 Read the whole article: algorithmwatch.org/en/when-will...

Melde solche Apps, Webseiten oder Accounts! Dein Hinweis hilft, diese Tools zu stoppen: algorithmwatch.org/de/lasst-uns...

Melde solche Apps, Webseiten oder Accounts! Dein Hinweis hilft, diese Tools zu stoppen: algorithmwatch.org/de/lasst-uns...

💶 83 % der Europäer*innen sagen, dass #Rechenzentren mehr bezahlen sollten: algorithmwatch.org/de/mehrheit-...

💶 83 % der Europäer*innen sagen, dass #Rechenzentren mehr bezahlen sollten: algorithmwatch.org/de/mehrheit-...

In Frankfurt sind Rechenzentren laut Öko-Institut (2025) bereits für 41 % des gesamten lokalen Stromverbrauchs verantwortlich.

In Frankfurt sind Rechenzentren laut Öko-Institut (2025) bereits für 41 % des gesamten lokalen Stromverbrauchs verantwortlich.

💡 Alle Ergebnisse und unsere Schlussfolgerungen: algorithmwatch.org/de/mehrheit-...

💡 Alle Ergebnisse und unsere Schlussfolgerungen: algorithmwatch.org/de/mehrheit-...

Kurzinfos:

⌛ 30–40 Stunden pro Woche

🗓️ Start: so bald wie möglich

⏱️ Bewerbungsfrist: Montag, 10.11.2025, 12:00 Uhr

📍 Arbeitsort: Berlin

Vollständige Stellenausschreibung: algorithmwatch.org/de/job-openi...

Kurzinfos:

⌛ 30–40 Stunden pro Woche

🗓️ Start: so bald wie möglich

⏱️ Bewerbungsfrist: Montag, 10.11.2025, 12:00 Uhr

📍 Arbeitsort: Berlin

Vollständige Stellenausschreibung: algorithmwatch.org/de/job-openi...

Hilf uns zu verstehen, was dich bewegt – in nur 5–10 Minuten: algorithmwatch.org/de/community...

Hilf uns zu verstehen, was dich bewegt – in nur 5–10 Minuten: algorithmwatch.org/de/community...

➡️ findhr.eu/toolkit/poli...

➡️ findhr.eu/toolkit/poli...

The use of AI-based software for personnel recruitment carries the risk of #discrimination. As part of #FINDHR, we have developed concrete recommendations for developers: findhr.eu/toolkit/deve...

The use of AI-based software for personnel recruitment carries the risk of #discrimination. As part of #FINDHR, we have developed concrete recommendations for developers: findhr.eu/toolkit/deve...

Our FINDHR-Toolkit for HR professionals offers insights on discrimination risks, legal frameworks, and what action you can take to counter #AlgorithmicDiscrimination: findhr.eu/toolkit/hr-p...

Our FINDHR-Toolkit for HR professionals offers insights on discrimination risks, legal frameworks, and what action you can take to counter #AlgorithmicDiscrimination: findhr.eu/toolkit/hr-p...

Wann: 09.10.2025 | 10:00 – 11:00 Uhr

Wo: Online

Wann: 09.10.2025 | 10:00 – 11:00 Uhr

Wo: Online

Newsletter subscribers can join the livestream: algorithmwatch.org/en/exclusive...

Newsletter subscribers can join the livestream: algorithmwatch.org/en/exclusive...